Зміст

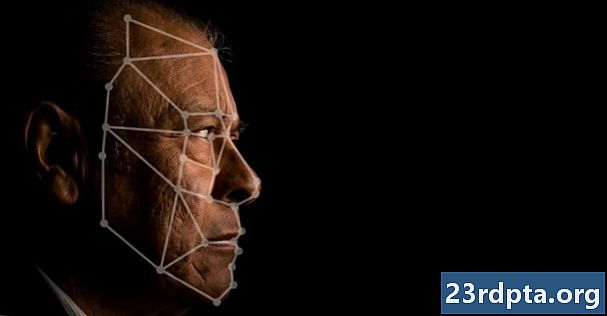

Зміст Deepfake створює хаос серед людей, які виросли з думкою, що бачити вірять. Фотографії та відео, які колись вважалися незаперечними свідченнями того, що щось відбувається, зараз масами ставиться під сумнів. Цього можна очікувати після з'ясування дивовижно реалістичного відео Барака Обами, який називає президента Трампа "тотальним і повним зануренням ****" - це не що інше, як глубоке створення.

Зміст Deepfake створює хаос серед людей, які виросли з думкою, що бачити вірять.

Едгар СервантесТехнолог, що займається питаннями, піднімає брови та генерує питання, саме тому ми тут, щоб дати вам повне глибоке поглиблення того, що це таке, як це працює, і якщо дійсно є причина для занепокоєння.

Що таке deepfake?

Deepfake - це AI (штучний інтелект) техніка, яка використовує машинне навчання для створення або маніпулювання вмістом. Його часто використовують для створення фотомонтажів або накладення обличчя людини поверх іншого, але його можливості виходять далеко за рамки цього. Ця технологія має безліч інших застосувань. До них належать маніпулювання або створення звуку, руху, пейзажі, тварини тощо.

Як працює deepfake?

Вміст Deepfake створюється за допомогою техніки машинного навчання, відомої як GAN (генеративна змагальна мережа). GAN використовують дві нейронні мережі: генератор та дискримінатор. Вони постійно конкурують один з одним.

Генератор спробує створити реалістичне зображення, тоді як дискримінатор намагатиметься визначити, підроблений він чи ні. Якщо генератор обдурить дискримінатора, дискримінатор використовує інформацію, зібрану, щоб стати кращим суддею. Так само, якщо дискримінатор визначає, що зображення генератора є фальшивим, генератор стане кращим у створенні підробленого зображення. Нескінченний цикл може тривати до тих пір, поки зображення, відео чи аудіо не перестають помітно підробити людську точку зору.

Витоки

Перші відео з глубоких фейків, очевидно, були порно!

Едгар СервантесПерші відео з глубоких фейків, очевидно, були порно! Більш конкретно, звичайно було бачити обличчя знаменитостей, накладених на порно актрис. Пам’ятки Ніколаса Кейджа також були популярними, серед інших веселих винаходів.

Слово deepfake стало синонімом цієї методики у 2017 році завдяки користувачеві Reddit, який отримав назву “deepfakes”. Користувача приєднали інші на тепер забороненому г / глибокі фейки subreddit, де вони поділилися своїми творами зі світом.

Справжній творець генеративних конкурентних мереж - Ян Гудфелло. Разом зі своїми колегами він представив цю концепцію в Монреальському університеті в 2014 році. Потім він перейшов працювати в Google, і в даний час працює в Apple.

Небезпеки

У чужих руках глибоке створення може бути використане для фальсифікації набагато більше, ніж дурні меми Ніколаса Кейджа.

Едгар СервантесХоча маніпулювання вмістом не є новим, воно вимагало серйозних навичок. Вам потрібен був потужний комп’ютер і справді вагома причина (або просто занадто багато вільного часу), щоб зробити підроблений контент. Програмне забезпечення для створення глибоких фейків, як FakeApp, є безкоштовним, легким для пошуку та не потребує великої потужності комп'ютера. І тому що вона робить всю роботу самостійно, вам не потрібно бути кваліфікованим редактором, щоб створювати шалено справжні глибокі медіа.

Ось чому широка громадськість, знаменитості, політичні уряди та уряди стурбовані глибинним рухом. У чужих руках глибоке створення може бути використане для фальсифікації набагато більше, ніж дурні меми Ніколаса Кейджа. Уявіть, що хтось створює фейкові новини або інкримінує відеодокази. До проблеми можна додати підроблені і помститися порно. Речі можуть швидко заплутатися.

Ще одна причина для занепокоєння з приводу глубокого вмісту - це те, що важливі особистості також можуть заперечувати минулі дії. Оскільки відео з глубоких фейків здаються настільки реальними, кожен може заявити, що справжній кліп - це глутфайк.

Читайте також: Складності етики та ШІ

Пошук рішення

Хоча дуже близький до реального, навчене око все ще може помітити підроблене відео, приділяючи пильну увагу. Турбота полягає в тому, що в якийсь момент у майбутньому ми не зможемо сказати різницю.

Twitter, Pornhub, Reddit та інші безуспішно намагалися позбутися такого вмісту. Що стосується більш офіційної сторони, DARPA (Агентство прогресивних науково-дослідних проектів в галузі оборони) співпрацює з науково-дослідними установами та Університетом Колорадо, щоб створити спосіб виявити глибокі факи.

Найкраще, що ми можемо зробити для боротьби з глибокими фальшивими відео - це бути більш спостережливими та менш довірливими.

Едгар СервантесПоки ми не маємо програмного забезпечення, яке може виявити порушення в таких відео, найкраще, що ми можемо зробити, - це більш спостережливість і менш легковажність. Проведіть свої дослідження, перш ніж припустити, що відео, зображення чи аудіо справжні. Це те, що ми мали би робити вже, як би там не було.

Популярний глубокий вміст

Джордан Піл приєднується до Buzzfeed, щоб скласти це відео, яке покликане створити свідомість.

Експерт з питань маніпуляцій в Інтернеті Клер Уордл показує нам, наскільки реалістично можуть виглядати ці відео, з'являючись Адель протягом перших 30 секунд відео. Це відео з The New York Times дає нам прекрасне розуміння теми.

Компанія Watchmojo дає куратор списку деяких найпопулярніших відео із глубоких фейків. Це веселе відео з великою кількістю чудових прикладів.

Ви турбуєтесь про наслідки глибинних відео? Це, безумовно, тема, яку ми повинні пам’ятати, працюючи над тим, щоб знайти рішення.